1. 前言

Qwen2.5-VL-32B-Instruct是阿里巴巴通义千问团队于2025年3月25日开源的多模态模型,深夜发布以下信息:

基于官方文档,我们来梳理一下目前开源的多模态模型有什么优越之处!!!

2. 特点

2.1. 多模态能力全面提升

- 视觉语言理解与推理:模型在图像解析、内容识别、视觉逻辑推导等任务中展现出更高的准确性和细粒度分析能力。例如,能根据交通指示牌照片分析时间、距离和限速信息,推理出卡车能否在指定时间内到达目的地。

- 数学推理能力:可解决复杂几何题、数列推导等数学问题,解题过程分步骤呈现,逻辑清晰。例如,通过角平分线和对顶角关系推导几何角度,或归纳正方形面积数列的通项公式。

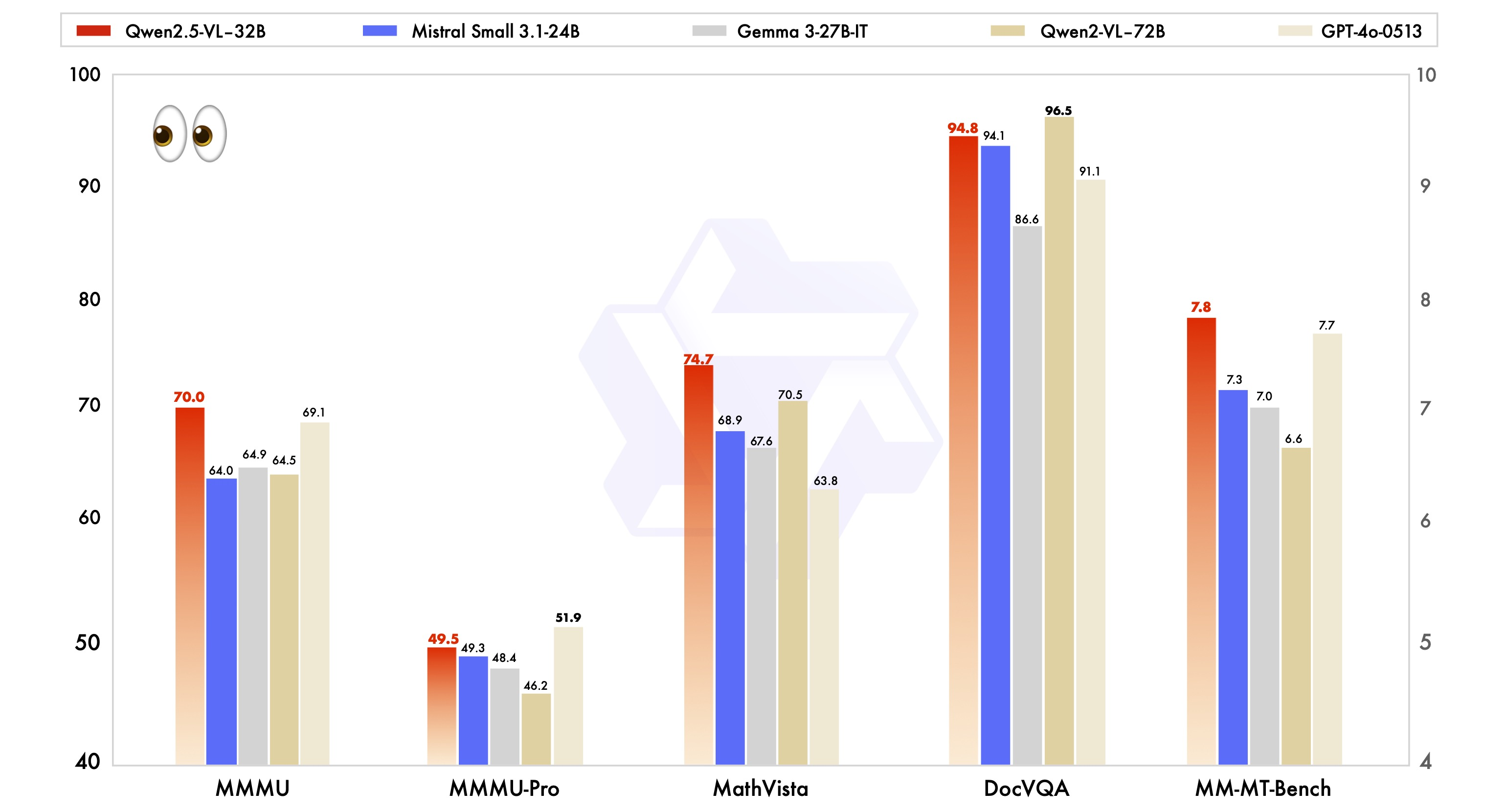

2.2. 性能超越更大规模模型

- 在多项基准测试(如MMMU、MathVista、MM-MT-Bench)中,32B版本的表现不仅优于同规模的Mistral-Small-3.1-24B和Gemma-3-27B-IT,甚至超过前代72B大模型。其纯文本处理能力在同规模模型中达到最优(SOTA)。

2.3. 本地部署与高效运行

- 32B参数规模在性能和硬件需求之间取得平衡,支持本地部署。例如,可在64GB内存的Mac上运行,同时保持其他应用(如浏览器、开发工具)的正常使用。

2.4. 强化学习优化用户体验

- 通过强化学习调整输出风格,回答更详细、格式规范且符合人类主观偏好。例如,对四川火锅的图片识别不仅标注食材,还会结合锅底设计、氛围等要素详细解释。

- 在快速思考(fast-thinking)模式下,模型能高效处理多步骤推理任务。

2.5. 开源协议与社区支持

- 采用Apache 2.0协议开源,开发者可灵活使用及二次开发。模型已上线Hugging Face平台,用户可通过QwenChat或MLX社区直接体验。

2.6. 应用场景广泛

- 适用于教育(数学题解析)、智能硬件(视觉交互)、科研(图像分析)等领域。例如,识别地理地形图、分析复杂几何图形等。

3. 未来方向

团队下一步计划聚焦于长且有效的视觉推理,以突破多步骤复杂任务的边界,进一步提升模型在高度复杂场景中的应用能力。

4. 总结

该模型通过算法优化与训练数据创新,验证了“小模型也能有大作为”的潜力,被视为中国开源模型崛起的标志性事件。

5. 参考资料

官方博客: https://qwenlm.github.io/blog/qwen2.5-vl-32b/

Qwen Chat: https://chat.qwen.ai/

HF: https://huggingface.co/Qwen/Qwen2.5-VL-32B-Instruct

ModelScope: https://modelscope.cn/models/Qwen/Qwen2.5-VL-32B-Instruct